ghostdog83

Verfasste Forenbeiträge

-

AutorBeiträge

-

8. Dezember 2025 um 23:39 als Antwort auf: Vor kurzem angespielt / Welche Spiele spielt Ihr zur Zeit? #1811231

ghostdog83Teilnehmer

ghostdog83TeilnehmerTrepang2 auf Sehr Schwer beendet.

Was mir gefällt, ist die Lernkurve: Ich bin auf dem Schwierigkeitsgrad reibungsloser unterwegs gewesen als bei meinem ersten Durchgang auf Normal.

Ohne Musik spielt es sich besser. Das Tapsen der Gegner ist leichter zu orten, dadurch sind sie besser beherrschbar.

Der Wiederspielwert ist dank des guten Gegnerverhaltens, der abwechslungsreichen Waffen und der Levelstruktur hoch (wenn man die Herausforderung sucht und sich verbessern möchte).

Einzig das einige Waffen auf den höheren Schwierigkeitsgraden kaum zu gebrauchen sind, fällt negativ auf.

Hat jemand das Spiel auf Extrem oder gar den Ragemodus durchgespielt?

ghostdog83Teilnehmer

ghostdog83TeilnehmerMicrosoft dementiert Bericht über Senkung der Wachstumsziele für den Verkauf von AI-Software

- Carlyle kürzt Ausgaben für Copilot Studio aufgrund von Datenintegrationsproblemen – laut Bericht

- Große Tech-Unternehmen stehen unter Druck, zu beweisen, dass ihre hohen Investitionen in AI Rendite bringen

- Microsoft-Aktien verringern Verluste nach Dementi, zuletzt minus 1,7 %

3. Dezember (Reuters) – Microsoft hat am Mittwoch einen Bericht von The Information dementiert, wonach mehrere Unternehmensbereiche die Umsatzwachstumsziele für bestimmte Produkte im Bereich künstliche Intelligenz gesenkt hätten, nachdem mehrere Vertriebsmitarbeiter ihre Ziele im im Juni endenden Geschäftsjahr verfehlt hatten.

Der auf Quellen basierende Bericht zitierte zwei Vertriebsmitarbeiter der Cloud-Computing-Sparte Azure, die von Investoren aufmerksam beobachtet wird, da sie der Hauptnutznießer der AI-Offensive von Microsoft (MSFT.O) ist.„Der Bericht von The Information vermischt fälschlicherweise die Konzepte von Wachstum und Verkaufsquoten, was zeigt, dass sie nicht verstehen, wie eine Vertriebsorganisation funktioniert und vergütet wird“, erklärte ein Unternehmenssprecher in einer Stellungnahme.

„Die Gesamtverkaufsquoten für AI-Produkte wurden nicht gesenkt, wie wir ihnen vor der Veröffentlichung mitgeteilt haben.“

Nach der Zurückweisung durch Microsoft konnten die Aktien, die zu Beginn des Handels um fast 3 % gefallen waren, ihre Verluste wieder ausgleichen. Zuletzt lag die Aktie um 1,7 % im Minus. Reuters konnte den Bericht von The Information nicht unabhängig überprüfen.

Sorgen über AI-Blase

Die steigenden Bewertungen von Technologieunternehmen und Anzeichen für eine langsame Einführung der neuen KI-Technologie haben in den letzten Monaten Befürchtungen hinsichtlich einer wachsenden Blase geschürt, ähnlich wie beim Dotcom-Boom der 1990er Jahre.

Eine MIT-Studie aus diesem Jahr ergab, dass nur etwa 5 % der KI-Projekte über die Pilotphase hinauskommen.

Der Bericht von The Information besagt, dass die Carlyle Group (CG.O)

im letzten Jahr damit begonnen hat, Copilot Studio zur Automatisierung von Aufgaben wie Besprechungszusammenfassungen und FinanzmodellenDem Bericht zufolge hatte eine US-Vertriebsabteilung von Azure den Vertriebsmitarbeitern Quoten vorgegeben, um die Ausgaben der Kunden für Foundry, ein Tool zur Entwicklung von AI-Anwendungen, im letzten Geschäftsjahr um 50 % zu steigern, aber weniger als ein Fünftel erreichte die Ziele.

Im Juli senkte das Unternehmen seine Ziele für das laufende Geschäftsjahr auf ein Wachstum von etwa 25 % gegenüber dem letzten Geschäftsjahr, hieß es.

Microsoft reagierte nicht auf Anfragen, ob Carlyle die Ausgaben für Copilot Studio gekürzt habe.

Mehrere Analysten sagten, dass sich die Unternehmen noch in einer frühen Phase der Einführung von KI befänden und einige Herausforderungen zu erwarten seien.

„Das bedeutet nicht, dass KI-Produkte nicht vielversprechend sind, um Unternehmen zu mehr Produktivität zu verhelfen, sondern nur, dass es schwieriger sein könnte als gedacht“, so Gil Luria, Analyst bei D.A. Davidson.

Die US-Technologiegiganten stehen unter dem Druck der Investoren, zu beweisen, dass ihre hohen Investitionen in die AI-Infrastruktur Renditen bringen.

Rekordausgaben

Microsoft meldete für sein erstes Geschäftsquartal im Oktober Rekordinvestitionen in Höhe von fast 35 Milliarden US-Dollar und warnte, dass die Ausgaben in diesem Jahr steigen würden. Insgesamt werden die US-Technologiegiganten in diesem Jahr voraussichtlich rund 400 Milliarden US-Dollar für AI ausgeben.

Die Unternehmen haben erklärt, dass diese Ausgaben notwendig sind, um Lieferengpässe zu überwinden, die ihre Fähigkeit beeinträchtigt haben, von der Nachfrage nach AI zu profitieren.

Microsoft geht davon aus, dass die AI-Kapazitäten mindestens bis zum Ende des laufenden Geschäftsjahres im Juni 2026 knapp bleiben werden.

Die Ausgaben haben sich für das von Satya Nadella geführte Unternehmen bislang ausgezahlt, da der Umsatz seiner Cloud-Computing-Sparte Azure im Zeitraum Juli bis September um 40 % gestiegen ist und damit die Erwartungen übertroffen hat. Auch die Prognose für das zweite Quartal lag über den Schätzungen.

Der AI-Schub hat Microsoft außerdem dabei geholfen, nach Nvidia das zweite Unternehmen zu werden, das in diesem Jahr eine Bewertung von 4 Billionen US-Dollar erreicht hat, obwohl sein Marktwert seitdem wieder zurückgegangen ist.

ghostdog83Teilnehmer

ghostdog83TeilnehmerMicrosoft senkt AI-Verkaufsziele um die Hälfte, nachdem Vertriebsmitarbeiter ihre Quoten verfehlt haben

Bericht: Microsoft hat im Mai „das Zeitalter der AI-Agenten“ ausgerufen, aber Unternehmenskunden sind davon nicht überzeugt.

Microsoft hat die Umsatzwachstumsziele für seine AI-Agent-Produkte gesenkt, nachdem viele Vertriebsmitarbeiter ihre Quoten im Geschäftsjahr, das im Juni endete, verfehlt hatten, wie aus einem Bericht von The Information vom Mittwoch hervorgeht. Die Anpassung ist für Microsoft angeblich ungewöhnlich und erfolgt, nachdem das Unternehmen eine Reihe ehrgeiziger Umsatzziele für seine AI-Angebote verfehlt hatte.

AI-Agenten sind spezialisierte Implementierungen von AI-Sprachmodellen, die dafür entwickelt wurden, mehrstufige Aufgaben autonom auszuführen, anstatt nur auf einzelne Eingaben zu reagieren. Sogenannte „agente“ Funktionen standen im Mittelpunkt der Verkaufsargumente von Microsoft für 2025: Auf seiner Build-Konferenz im Mai erklärte das Unternehmen, dass es in „die Ära der AI-Agenten“ eingetreten sei.

Das Unternehmen hat seinen Kunden versprochen, dass Agenten komplexe Aufgaben automatisieren können, wie beispielsweise die Erstellung von Dashboards aus Verkaufsdaten oder das Verfassen von Kundenberichten. Auf seiner Ignite-Konferenz im November kündigte Microsoft neue Funktionen wie Word-, Excel- und PowerPoint-Agenten in Microsoft 365 Copilot sowie Tools zum Erstellen und Bereitstellen von Agenten über Azure AI Foundry und Copilot Studio an. Doch nun, da sich das Jahr dem Ende zuneigt, hat sich dieses Versprechen als schwieriger zu erfüllen erwiesen, als das Unternehmen erwartet hatte.

Laut The Information hat eine US-amerikanische Azure-Vertriebseinheit Quoten für Vertriebsmitarbeiter festgelegt, um die Kundenausgaben für ein Produkt namens Foundry, das Kunden bei der Entwicklung von AI-Anwendungen unterstützt, um 50 Prozent zu steigern. Weniger als ein Fünftel der Vertriebsmitarbeiter dieser Einheit erreichte ihre Foundry-Umsatzwachstumsziele. Im Juli senkte Microsoft diese Ziele auf ein Wachstum von etwa 25 Prozent für das laufende Geschäftsjahr. In einer anderen US-Azure-Einheit verfehlten die meisten Vertriebsmitarbeiter eine frühere Quote zur Verdopplung des Foundry-Umsatzes, woraufhin Microsoft ihre Quoten für das laufende Geschäftsjahr auf 50 Prozent senkte.

Die Verkaufszahlen deuten darauf hin, dass Unternehmen noch nicht bereit sind, Premium-Preise für diese AI-Agent-Tools zu zahlen. Und Microsofts Copilot selbst steht vor einer Herausforderung hinsichtlich der Markenpräferenz: Anfang dieses Jahres berichtete Bloomberg, dass Microsoft-Vertriebsmitarbeiter Schwierigkeiten hatten, Copilot an Unternehmen zu verkaufen, da viele Mitarbeiter stattdessen ChatGPT bevorzugen. Der Arzneimittelhersteller Amgen kaufte Berichten zufolge Copilot-Software für 20.000 Mitarbeiter, aber viele Mitarbeiter tendierten stattdessen zum Chatbot von OpenAI, wobei Copilot hauptsächlich für Microsoft-spezifische Aufgaben wie Outlook und Teams verwendet wurde.

Ein Microsoft-Sprecher lehnte es ab, sich zu den Änderungen der Verkaufsquoten zu äußern, als er von The Information dazu befragt wurde. Hinter diesen rückläufigen Verkaufszahlen könnte jedoch ein tieferes, grundlegenderes Problem stecken: Die AI-Agent-Technologie ist wahrscheinlich noch nicht bereit für die Art von autonomen Geschäftsaufgaben mit hohem Einsatz, die Microsoft verspricht.

Die Kluft zwischen Versprechen und Realität

Die Konzepte hinter agentenbasierten AI-Systemen entstanden kurz nach der Veröffentlichung von OpenAI’s GPT-4 im Jahr 2023. Sie beinhalten in der Regel die Auslagerung von „Arbeiteraufgaben” an AI-Modelle, die parallel zu einem übergeordneten AI-Modell laufen, und integrieren Techniken zur Bewertung und Umsetzung ihrer eigenen Ergebnisse. In den letzten Jahren haben Unternehmen wie Anthropic, Google und OpenAI diese frühen Ansätze zu weitaus nützlicheren Produkten für Aufgaben wie die Softwareentwicklung weiterentwickelt, aber sie sind immer noch fehleranfällig.

Das Kernproblem ist die Tendenz von AI-Sprachmodellen zur Konfabulation, was bedeutet, dass sie mit großer Sicherheit falsche Ergebnisse generieren können, die als Fakten dargestellt werden. Zwar haben sich die Probleme mit Konfabulationen im Laufe der Zeit mit neueren AI-Modellen verringert, wie wir aus aktuellen Studien wissen, doch können die simulierten Argumentationstechniken, die hinter den derzeit auf dem Markt erhältlichen agentenbasierten AI-Assistenten stehen, immer noch katastrophale Fehler machen und diese weiterverfolgen, was sie für die Art von autonomer Arbeit, die Unternehmen wie Microsoft versprechen, unzuverlässig macht.

Obwohl agentenbasierte Systeme mit Schleifen ihre eigenen Fehler besser erkennen können als ein einzelnes AI-Modell, unterliegen sie dennoch den grundlegenden Einschränkungen der Mustererkennung der zugrunde liegenden AI-Modelle, insbesondere wenn sie mit neuen Problemen konfrontiert werden, die außerhalb ihrer Trainingsverteilung liegen. Wenn ein Agent also nicht richtig für die Ausführung einer Aufgabe trainiert ist oder auf ein einzigartiges Szenario stößt, könnte er leicht falsche Schlussfolgerungen ziehen und kostspielige Fehler für ein Unternehmen begehen.

Die „Sprödigkeit” aktueller AI-Agenten ist der Grund, warum das Konzept der künstlichen allgemeinen Intelligenz (AGI) für die AI-Branche so attraktiv ist. In der künstlichen Intelligenz bedeutet „allgemeine Intelligenz” in der Regel ein AI-Modell, das neue Aufgaben lernen oder ausführen kann, ohne dass ihm zuvor Tausende oder Millionen von Beispielen dafür gezeigt werden müssen. Obwohl AGI ein nebulöser Begriff ist, der in der Praxis schwer zu definieren ist, würde ein solches allgemeines AI-System, wenn es jemals entwickelt würde, hypothetisch einen weitaus kompetenteren agentenbasierten Mitarbeiter hervorbringen als das, was AI-Unternehmen heute anbieten.

Trotz dieser Schwierigkeiten investiert Microsoft weiterhin stark in die AI-Infrastruktur. Das Unternehmen meldete für sein im Oktober endendes erstes Geschäftsquartal Kapitalausgaben in Höhe von 34,9 Milliarden US-Dollar, was einen Rekord darstellt, und warnte davor, dass die Ausgaben weiter steigen würden. The Information merkt an, dass ein Großteil der AI-Einnahmen von Microsoft nicht von traditionellen Unternehmen stammt, die Ai-Tools für ihre eigenen Abläufe einsetzen, sondern von AI-Unternehmen selbst, die Cloud-Infrastruktur mieten.

Während derzeit alle Augen auf eine mögliche Blase auf dem AI-Markt gerichtet sind, scheint Microsoft eine Infrastruktur für eine Revolution aufzubauen, für die sich viele Unternehmen noch nicht entschieden haben.

ghostdog83Teilnehmer

ghostdog83TeilnehmerMicrosoft geht Berichten zufolge eine Partnerschaft mit Foxconn ein, um die Xbox-Produktion um „4,8 Millionen“ Geräte pro Jahr zu steigern – während Grand Theft Auto 6 in den Startlöchern steht.

Ob es nun Probleme mit der Verfügbarkeit von Xbox-Konzolen oder Zölle sind, die Preissteigerungen auslösen – die Xbox Series X|S-Hardware kommt einfach nicht zur Ruhe.

Als US-Präsident Trump einen Handelskrieg mit China begann, führte dies zu massiven Preissteigerungen bei einer Vielzahl von Produkten. Besonders hart getroffen wurden Videospielkonsolen, die nicht die gleichen Ausnahmeregelungen wie andere Elektronikgeräte genießen. Die Vereinigten Staaten haben beispielsweise Apples iPhones von den Zöllen ausgenommen, um eines ihrer führenden nationalen Technologieunternehmen zu schützen. Diese Gnade wurde jedoch nicht auf den einzigen noch verbliebenen US-amerikanischen Konsolenhersteller ausgedehnt: die gute alte Xbox.

Seit der Markteinführung der Xbox Series X und Xbox Series S war Microsoft von Anfang an stark und übertraf sogar einige Monate lang die PlayStation 5 beim Umsatz in US-Dollar (laut The Verge und Circana). Doch dann begann die PS5 in Sachen Verfügbarkeit die Nase vorn zu haben. Seitdem konnte die Xbox nicht mehr mithalten und verzeichnete in den letzten Jahren fast jedes Quartal einen Rückgang bei den Hardware-Verkäufen. Erschwerend kam hinzu, dass das Unternehmen vor einigen Monaten gezwungen war, die Preise anzuheben, wodurch die Xbox Series X und in einigen Fällen auch die weniger leistungsstarke Xbox Series S teurer wurden als einige PS5-Modelle. Die Zölle haben maßgeblich dazu beigetragen, dass die Xbox Series X|S weniger wettbewerbsfähig ist.

Um solche Preiserhöhungen zu vermeiden, haben Hersteller wie Sony PlayStation und Nintendo einen Teil ihrer Hardware-Produktion aus China verlagert, das von Trumps Zolloffensive unverhältnismäßig stark betroffen ist. Ein Land, das davon profitiert hat, ist Vietnam, das zunehmend seine Position in der Herstellung aller Arten von Elektronikprodukten ausbaut. Zu diesen Produkten zählt nun auch die Xbox.

In einem neuen Bericht von Reuters heißt es, dass die Elektronikfertigungsriesen Foxconn und Luxshare bei den lokalen Behörden Planungsvorschläge eingereicht haben, die speziell auf den Ausbau ihrer Präsenz im Bereich der Videospielkonsolen abzielen.

Fushan Technology, ein Teil von Foxconn, beantragt laut dem Bericht Produktionsgenehmigungen speziell für Microsoft Xbox-Spielgeräte. Fushan strebt im Rahmen der Genehmigung eine Steigerung um bis zu 4,8 Millionen zusätzliche Xbox-Spielgeräte an, darunter wahrscheinlich Xbox Series X|S-Konsolen, offizielle Xbox-Controller, Zubehör wie das offizielle Xbox-Headset und möglicherweise sogar Xbox Cloud Gaming-Servertechnologie. Beachten Sie, dass dies nicht das Xbox Ally-Handheld umfasst, das trotz der Markenbezeichnung nicht von Microsoft, sondern von ASUS hergestellt wird. Das chinesische Unternehmen Luxshare-ICT hat ebenfalls Vorschläge zur Erweiterung seiner eigenen Konsolenproduktion um zusätzliche 4,5 Millionen Einheiten pro Jahr vorgelegt.

Microsoft hat seine Xbox Series X-Siliziumchips zwischen Xbox Series X-Konsolen für den Einzelhandel und Xbox Cloud Gaming-Servern aufgeteilt, da es seine Kapazitäten in Ländern wie Brasilien und Indien ausbaut, die ebenfalls unverhältnismäßig stark unter Zöllen und Steuern leiden, die die lokalen Hardwarepreise für Xbox in die Höhe treiben. Microsoft gab kürzlich bekannt, dass die Nutzung von Xbox Cloud Gaming im Vergleich zum Vorjahr um 45 % gestiegen ist, obwohl das Angebot an Xbox Series X|S zurückgeht.

Eine Frage, die mir in den sozialen Medien immer wieder gestellt wird, ist, ob Xbox aus dem Konsolenhardware-Geschäft aussteigt. Microsoft hat seine Pläne zur Entwicklung einer Xbox-Konsole der nächsten Generation bekräftigt, die mehr denn je einem PC ähneln und Steam sowie andere Windows-PC-Anwendungen und Gaming-Plattformen ausführen können soll. Ein weiterer Grund, warum viele glauben, dass Xbox aus dem Hardware-Geschäft aussteigt, ist die Verfügbarkeit der Xbox Series X|S, die in einigen Regionen oft schwer zu finden ist.

Tatsächlich hat Microsoft aufgrund der Lieferengpässe keine Sonderangebote für die Xbox Series X|S zum Black Friday und Cyber Monday angeboten. Die Diversifizierung der Lieferkette wird hoffentlich dazu beitragen, die Produktion der Xbox Series X|S in einem für die Plattform möglicherweise sehr wichtigen Jahr anzukurbeln. Allerdings könnten die Lieferengpässe bei DRAM-Speichern und die Preissteigerungen bis 2026 diese Bemühungen für alle Beteiligten zunichte machen.

Für Millionen von Xbox-Nutzern, die noch mit Xbox One X- und Xbox One S-Konsolen spielen, wird Grand Theft Auto 6 wahrscheinlich zu einem Upgrade-Boom führen, wie es ihn seit der Einführung der Xbox Series X|S im Jahr 2020 nicht mehr gegeben hat.

Microsoft kann es sich nicht leisten, für dieses seltene Gaming-Ereignis keine Lagerbestände zur Verfügung zu haben, zumal Grand Theft Auto 6 zum Start nur auf Xbox Series X|S und PS5 erhältlich sein wird. Die Xbox Series S könnte die „günstigste“ Möglichkeit sein, um auf das Spiel zuzugreifen – aber nur, wenn man tatsächlich eine zum Kauf findet.

ghostdog83Teilnehmer

ghostdog83TeilnehmerIch bin gespannt, wie gut es mit HDR aussehen wird, da ich die Funktion bei jedem Switch 2 Spiel bisher ausgeschaltet habe, da sie nichts taugte.

Da du das Thema ansprichst – ein sehr lesenswertes Interview:

Das HDR-Gaming-Interview – Ein erfahrener Entwickler erklärt die traurige Lage und wie er Abhilfe schaffen will

Vor fast zehn Jahren schrieb ich einen Meinungsbeitrag darüber, dass HDR-Gaming das bahnbrechendste Feature der kommenden PlayStation 4-Konsolenaktualisierung sei, die damals als „PS4K” bekannt war und später am 10. November 2016 als PlayStation 4 Pro veröffentlicht wurde. Erste Informationen deuteten darauf hin, dass sie im Gegensatz zum PS4-Basismodell HDR-Unterstützung bieten würde; Sony führte diese Funktion jedoch später auch für normale PlayStation 4-Konsolen ein.

Abgesehen von diesen Details basierte der Artikel auf der Überzeugung, dass HDR-Gaming das nächste große Ding in der Computergrafik sein würde, sogar noch mehr als die 4K-Auflösung (Ultra HD). Es gab zahlreiche Belege dafür, dass dies zutraf. Microsoft und AMD hatten bereits verkündet, dass erste Nutzerumfragen darauf hindeuteten, dass HDR revolutionär und sogar noch wirkungsvoller als eine höhere Auflösung sein würde. Außerdem würde HDR im Gegensatz zum Rendern eines Spiels mit einer höheren Auflösung die Leistung nicht beeinträchtigen.

Die ersten Jahre waren in der Tat vielversprechend. Führende Spieleentwickler wie Naughty Dog und Playground Games erklärten öffentlich, dass die HDR-Unterstützung „ein enormer Vorteil” sei und etwas, das man „nicht mehr missen möchte”. Auf der CES 2017 stellte NVIDIA seine G-SYNC HDR-Monitore vor, mit denen Gamer sowohl G-SYNC- als auch HDR-Unterstützung in ihren Spielen genießen können. Im Juli 2018 gründeten Konsolenhersteller wie Microsoft und Sony, Displayhersteller wie ASUSTek, HP, LG, Panasonic, Samsung, Toshiba und Vizio sowie Spieleentwickler wie Activision, CAPCOM, EA, Epic Games, Electronic Arts, SIE, Square Enix, Ubisoft, Vicarious Visions und WB Games die HDR Gaming Interest Group (HGiG), um Inhalte für Zuschauer zu optimieren.

Alles schien bereit für die HDR-Revolution, doch wenn wir einen Blick auf die traurige Situation von heute werfen, müssen wir analysieren, was schiefgelaufen ist. Ende 2025, nachdem praktisch jedes Display, das man kaufen kann, HDR in gewisser Weise unterstützt, werden einige hochkarätige Spiele immer noch ohne Unterstützung dieser Funktion ausgeliefert. In diesem Jahr war dies der Fall bei Vampire: The Masquerade – Bloodlines 2, Hades 2, Clair Obscur: Expedition 33, ARC Raiders und Kingdom Come: Deliverance II (das später einen HDR-Patch erhielt).

Es ist ein regelrechter Schlag ins Gesicht all jener Verbraucher, die hochmoderne HDR-Displays gekauft haben, die Spitzenwerte von über 2K Nits oder Candela pro Quadratmeter, der Einheit für die Leuchtdichte, erreichen können, während Standard Dynamic Range (SDR)-Displays bei 100 Nits stagnieren. Ganz zu schweigen von den im Vergleich zu Rec. 2020, das einen viel größeren Farbraum darstellen kann, weit unterlegenen Farbformaten Rec. 709/sRGB.

Trotz dieses enormen technischen Unterschieds scheint es, als würde dies den meisten Entwicklern heutzutage völlig egal sein. Selbst Spiele, die diese Funktion technisch unterstützen, liefern oft minderwertige Implementierungen, die den Ruf von HDR nur noch weiter schädigen. Ein aktuelles Beispiel ist Silent Hill f, wo HDR offenbar nicht über die Farbkorrektur verfügt, die die Entwickler für SDR (die interne Entwicklungsreferenz) vorbereitet hatten, was zu einem völlig anderen Erscheinungsbild führt.

Ich habe Kontakt zu meinem Kollegen Filippo Tarpini aufgenommen, einem erfahrenen Grafikprogrammierer, der bei FireSprite und Remedy gearbeitet hat. Bei Remedy arbeitete er an der Control HDR-Mod (in seiner Freizeit, seine Arbeit wurde später mit einem offiziellen Patch implementiert) sowie an der HDR-Implementierung für Alan Wake II. Außerdem entwickelte er die Luma HDR-Mod für Starfield und andere Spiele wie Prey und Hollow Knight: Silksong. Vor kurzem gründete er Gamma Studios, ein kleines Unternehmen, das sich darauf spezialisiert hat, Spielestudios dabei zu helfen, „ihre Post-Processing-Pipelines zu verbessern, HDR-Ausgabe zu implementieren und moderne Farbkorrekturen durchzuführen”.

Obwohl er über einige der Spielprojekte, an denen er in letzter Zeit gearbeitet hat, nicht sprechen kann, arbeitet er auch mit NVIDIA zusammen, um HDR in die RTX Remix-Plattform zur Remastering von Spielen zu integrieren. Da Tarpini einer der führenden Experten auf diesem Gebiet ist (er ist auch Mitbegründer der HDR Den-Community, die sich der Fehlerbehebung und Verbesserung von HDR in PC-Spielen widmet), habe ich ihn gebeten, offen darüber zu sprechen, was bei HDR-Spielen falsch läuft und was getan werden muss, damit sie so hell wie möglich strahlen (im wörtlichen und übertragenen Sinne).

Interview mit Filippo Tarpini (u. a. für die HDR-Implementierung zu Control, Alan Wake II, Silksong verwantwortlich):

Hallo, Filippo. Erzähl uns ein bisschen was über dich.

Nach Jahren in der Spieleentwicklung verlagerte sich mein Fokus auf einen weitgehend übersehenen Bereich der Spiele: Tonemapping und Grading. Abgesehen von meiner Leidenschaft für gut aussehende Spiele gibt es in dieser Branche buchstäblich eine Lücke, in der das Wissen über die letzten Schritte des „Renderings” rar und voller Fehlinformationen ist. Deshalb versuche ich, HDR-Gaming zu unterstützen, da es wirklich mehr Aufmerksamkeit verdient.

Wie wird deiner Meinung nach die Situation bei HDR-Spielen Ende 2025 aussehen? Gibt es eine Gaming-Plattform, die etwas besser abschneidet, oder sind sie alle auf dem gleichen Niveau?

Es tut mir leid, dass ich mit einer negativen Bemerkung beginne… Sagen wir einfach, dass von den 25 größten und besten Spielen des Jahres 2025 die Hälfte HDR nicht unterstützt und die andere Hälfte, von wenigen Ausnahmen abgesehen, erhebliche Mängel aufweist, wie z. B. zu dunkle oder zu helle Schwarztöne, verzerrte Farbtöne, abgeschnittene oder eingeschränkte Helligkeitsbereiche, fehlende Kalibrierungseinstellungen, schlechte Benutzeroberfläche usw.

In fast allen Fällen ist klar, dass das Spiel auf und für SDR entwickelt wurde, wobei HDR nur eine nachträgliche Idee ist, die nur gelegentlich die künstlerische Ausrichtung widerspiegelt, da man anhand der visuellen Konsistenz leicht erkennen kann, wann SDR die visuelle Referenz war. Was die Plattformen angeht, gibt es in der Regel keinen Unterschied; fast alle Spiele haben genau die gleiche HDR-Implementierung.

Ich persönlich bevorzuge den Ansatz von Sony gegenüber dem von Microsoft, aber es gibt keinen klaren Gewinner. Windows ist auch in Ordnung, wenn es um die Anzeige von HDR-Inhalten geht. Die HDR-Implementierung der Switch 2 scheint nicht dem Standard zu entsprechen; allerdings habe ich sie nicht selbst analysiert, sodass ich sie nicht wirklich beurteilen kann.

Warum vernachlässigen Spieleentwickler HDR, obwohl die meisten Displays und Monitore heutzutage mit HDR-Funktionen ausgestattet sind? Ist die Implementierung so aufwendig?

Ich bin mir nicht ganz sicher, wie es um HDR bei Monitoren im Jahr 2025 stehen wird, da es in der Vergangenheit eine ganze Reihe von „fake“ HDR-Modellen gab, die den Ruf dieser Technologie etwas ramponiert haben. Allerdings sind die meisten Fernseher, die nicht zur Einstiegsklasse gehören, mittlerweile mit guter bis ordentlicher HDR-Technologie ausgestattet! Ich habe versucht, an diese Daten heranzukommen, aber offenbar verfolgt niemand diese Entwicklung. Zumindest ist klar, dass OLED zum neuen Goldstandard für Mittel- bis High-End-Displays wird.

Ich glaube, dass Gamer sich irgendwie nicht bewusst sind, welchen Mehrwert HDR für das Spielerlebnis bietet. Das Marketing drängt Sie dazu, sich für die heißeste GPU zu interessieren, aber niemand wirbt für HDR, da es keinen einzigen Hersteller gibt, der dahintersteht. GPU-Hersteller wenden sich oft mit Vorschlägen zur Implementierung von Ray Tracing oder exklusiven Funktionen ihrer GPUs an Spielestudios, aber bei HDR ist das nicht der Fall. Aus den oben genannten Gründen haben Entwickler den Eindruck, dass HDR eine Nischentechnologie ist und sich der Aufwand nicht lohnt. Ende 2025 ist diese Haltung jedoch völlig überholt!

Wenn Sie jedoch wissen, was Sie tun, ist das Hinzufügen von HDR nicht schwer, aber es hängt davon ab, wie flexibel Ihre Spiel-Engine ist. Ich habe Engines gesehen, die sehr HDR-freundlich waren, und andere, die es nicht waren. In Unreal und Unity, die die meisten aktuellen Spiele unterstützen, ist die Aktivierung von HDR so einfach wie das Aktivieren eines Kontrollkästchens. Allerdings weisen beide große Mängel in ihrer Implementierung auf. Letztendlich kommt es darauf an, ob ein Studio jemanden hat, der sich für Nachbearbeitung und Codierung („Gamma“) begeistert. Das scheint nicht sehr häufig vorzukommen, wobei auch die begrenzten Entwicklungszeiten eine Rolle spielen.

Als professioneller Spieleentwickler, welche Erfahrungen hast du gemacht, als du versucht hast, mehr Aufmerksamkeit für diesen speziellen Bereich zu erregen?

Das ist sehr unterschiedlich. Im Durchschnitt würde ich sagen, dass das Interesse daran noch sehr gering ist, während die falschen Vorstellungen groß sind. Ein großes Hindernis bei der Implementierung von HDR in Spielen ist, dass sie auch ohne HDR funktionieren! Alle Spiele leiden im Wesentlichen unter Budget- und Entwicklungszeitmangel, sodass alles, was nicht unbedingt notwendig ist, so spät wie möglich hinzugefügt wird. Es ist unklar, wie stark HDR den Umsatz beeinflusst, aber sicherlich nicht in großem Umfang, sodass die meisten Entwickler es bis zur letzten Minute aufschieben und manchmal sogar erst nach der Veröffentlichung hinzufügen.

Warum HDR nicht als „unverzichtbar” angesehen wird, ist eine andere Geschichte. Ich war sicherlich verwirrt darüber, dass sich die Studios auf Ray Tracing und andere Grafikfunktionen konzentrieren, die wohl weniger Einfluss haben und schwieriger zu implementieren sind, während sie HDR völlig ignorieren. Wenn ich mit anderen Entwicklern spreche, habe ich oft das Gefühl, dass sie HDR gegenüber skeptisch sind, als hätten sie Angst davor, diese neue Technologie zu übernehmen, die sich von dem unterscheidet, was sie gewohnt sind. Sie haben oft die falsche Vorstellung, dass SDR perfekt standardisiert ist, während HDR ein heilloses Durcheinander ist.

Nichts könnte weiter von der Wahrheit entfernt sein. SDR, wie wir es kennen, wurde weder hinsichtlich der Helligkeit noch der Übertragungsfunktion standardisiert, sodass jeder Fernseher/Monitor sehr unterschiedlich aussieht. Ironischerweise sind die häufigsten Probleme bei HDR-Implementierungen auf Probleme mit SDR zurückzuführen, die aufgrund von Fehlinterpretationen der Standards übernommen wurden. Es besteht eine große Diskrepanz zwischen den Farbstandards auf dem Papier und dem, was die Displayhersteller seit Jahren tatsächlich befolgen. Diese Probleme blieben 20 Jahre lang unbemerkt, da die Entwickler nicht in der Lage waren, die Ergebnisse außerhalb des SDR-Ökosystems zu analysieren.

Gibt es ein Triple-A-Spiel (an dem du nicht mitgearbeitet hast), das HDR standardmäßig wirklich gut umsetzt?

Mir hat das HDR in Dead Space und Red Dead Redemption II sehr gut gefallen. Wenn man sie technisch mit dem Blick eines Spielers aus dem Jahr 2025 betrachtet, weisen beide hier und da Mängel auf, aber dennoch erzielen sie ein gutes Ergebnis, was zum Teil auf die starke künstlerische Gestaltung zurückzuführen ist. Ich glaube, mit etwas mehr Arbeit hätten sie mit ihrem beeindruckenden HDR in die Geschichte eingehen und sogar den Ruf dieser Technologie verbessern können.

Ich denke, dass auch einige AAA-Spiele von Sony und Call of Duty-Spiele über gutes HDR verfügen, obwohl ich in letzter Zeit keine gespielt habe. Was ich zumindest sagen kann, ist, dass diese Spiele in HDR so aussehen werden, wie sie sollen, da die Teams hinter ihnen dies testen und sorgfältig ausbalancieren.

Jetzt, wo du ein Unternehmen leitest, das Entwickler bei HDR unterstützt, glaubst du, dass HDR Den und Luma dazu beigetragen haben, dass andere auf deine Arbeit aufmerksam geworden sind?

Ja. Die HDR Den wächst immer noch stark. Wir haben kürzlich unseren Reddit-Account (r/HDR_Den) eröffnet, um sowohl Spielern als auch Entwicklern dabei zu helfen, Informationen zu dieser „obskuren” Technologie zu finden. Wir haben ziemlich viele Spieleentwickler in Discord und es gibt oft interessante technische Diskussionen. Wir alle tauschen Informationen aus, was im Grunde bedeutet, dass wir viel schneller lernen können als jedes AAA-Studio, da wir 5 bis 10 engagierte Modder haben, die Tag und Nacht an diesem Thema forschen, alles Mögliche ausprobieren und die Ergebnisse ihrer Forschungen miteinander teilen.

Diese Informationen findet man nirgendwo anders, es sei denn, man verbringt selbst Monate damit, sie zu recherchieren.

Ich wurde tatsächlich von einigen Entwicklern wegen meiner Arbeit bei Remedy und an Luma kontaktiert, aber ein Großteil davon ist auch darauf zurückzuführen, dass ich meine Arbeit in sozialen Netzwerken, auf Reddit usw. geteilt habe. Aufgrund seiner Beliebtheit ist mein meistgefragtes Produkt mein Unreal Engine HDR-Verbesserungspaket. Einige Spiele haben auch den „Luma”-Open-License-Code verwendet und mitgeliefert! Selbst Luma ist stärker denn je. Kürzlich haben sich einige großartige Entwickler dem Projekt angeschlossen und neue, beeindruckende Mods entwickelt, wie beispielsweise einen einheitlichen Mod, der die TAA-Implementierung aller UE4-Spiele in DLSS/FSR umwandelt. Wir haben kürzlich eine neue Methode entwickelt, um Spiel-Shader direkt im Speicher zu patchen, was die Tür für fortschrittlichere Modding-Möglichkeiten öffnet, als dies jemals zuvor möglich war.

Was kann noch getan werden, um das Bewusstsein für die potenziellen Vorteile von gut gestalteten HDR-Effekten in Spielen zu schärfen?

Abgesehen davon, dass Dolby oder Samsung ihre exklusiven HDR-Technologien (Dolby Vision/HDR10+) vorantreiben oder ich überall Pro-HDR-Inhalte poste, tut sich derzeit nicht viel.

Beginnen wir mit der aktuellen Situation. Smartphones verfügen über fantastisches HDR, iPhone-Videos und -Fotos sind jetzt in HDR und viele der auf Instagram und YouTube hochgeladenen Kurzfilme sind ebenfalls in HDR. Aber wenn es um Computer geht, ist es ziemlich katastrophal:

- Die Hälfte der Monitore verfügt über „fake” HDR-Panels, die schlechter aussehen als SDR.

- Windows zeigt SDR-Inhalte in HDR auf „fehlerhafte” Weise an (alle Farben sind verfälscht).

- Windows aktualisiert SDR-Inhalte mit einer ungeeigneten Formel auf HDR (AutoHDR).

- Die beiden großen Spiel-Engines unterstützen HDR nicht von Haus aus richtig.

- Wir haben YouTube, das eine Woche braucht, um ein Video zu veröffentlichen, das in HDR hochgeladen wurde.

- Wir brauchen Mods wie RenoDX oder Luma, um das HDR in den meisten Spielen zu korrigieren.

Ähnlich sieht es bei Filmen aus, denen es nicht viel besser geht – vielleicht sogar noch schlechter. HDR in Filmen ist oft buchstäblich SDR in einem HDR-Container oder kaum 10 % heller als SDR. All dies schadet dem Ruf und der Bekanntheit von HDR. Was könnte man also tun?

Sony und Microsoft könnten Entwickler dazu drängen, geeignete Kodierungs- und Kalibrierungstechniken zu verwenden und diese Praktiken zu einem Teil ihrer Qualitätssicherung für Spiele zu machen, die auf ihren Plattformen veröffentlicht werden. Die Verbreitung von sRGB sollte eingestellt werden, da es sich um einen veralteten Standard handelt. TV-Hersteller sollten häufiger mit Entwicklern in Kontakt treten, um Kooperationen anzubahnen. Es muss ein Konsortium gegründet werden, um zu definieren, wie Spiele HDR implementieren sollten, und um eine Reihe von Funktionen zu standardisieren.

Wenn beispielsweise die Helligkeitskalibrierung auf Betriebssystemebene standardisiert wäre, müssten Spiele keine individuellen Kalibrierungsmenüs implementieren. Spielerezensenten könnten beginnen, über die HDR-Implementierung zu diskutieren und sie zu kritisieren, wenn sie unzureichend oder nicht zufriedenstellend ist. Sie könnten anderen Menschen erzählen, wie fantastisch HDR ist.

Das HGiG-Format wurde eingeführt, um HDR-Gaming zu fördern und zu standardisieren. Allerdings sind die Kalibrierungseinstellungen in Spielen oft sehr unterschiedlich, was für Nutzer verwirrend sein kann. Sollte HGIG (oder ein anderes Thema) in dieser Hinsicht mehr tun?

HGiG ist ein passiver Standard: Er sorgt lediglich dafür, dass der Fernseher ein Bild so wiedergibt, wie es von der Quelle (z. B. PC/PS5) kommt, ohne dessen durchschnittliche oder maximale Helligkeit usw. zu verändern. Die Alternative zu HGiG ist das dynamische Tonemapping, das meiner Meinung nach mittlerweile weitgehend überholt ist.

Die Kalibrierung von HDR-Spielen wäre also eigentlich eine extrem einfache Sache. Ich glaube, dass die meisten Entwickler davor zurückschrecken und oft zu viel darüber nachdenken, was mehr Verwirrung stiftet als alles andere. Alles, was man braucht, sind eine Spielszene und Schieberegler für die Helligkeit der Benutzeroberfläche. Die Spitzenhelligkeit des Displays kann (und sollte) vom Betriebssystem abgerufen werden. Das Kalibrierungsmenü von Alan Wake 2 macht genau das, ebenso wie meine Mods.

Wir haben einige Spiele, die den Benutzern 5 oder 6 Schieberegler zur Verfügung stellen (Belichtung, durchschnittliche HDR-Helligkeit, HDR-Schatten, HDR-Lichter, Kontrast, Sättigung), mit denen die Benutzer das Aussehen des Spiels komplett verändern können, ohne dass klar ist, wie das Spiel eigentlich aussehen soll. Ich glaube, dass diese „erweiterten” Kalibrierungsmenüs eine Folge der falschen Annahme der Entwickler sind, dass HDR nicht richtig standardisiert ist und dass alle HDR-Displays so unterschiedlich sind, dass sie den Benutzern eine Möglichkeit bieten müssen, ein gut aussehendes Bild zu erzeugen.

Das ist jedoch nicht der Fall! Im Durchschnitt sind HDR-Displays genauer als SDR-Displays in Bezug auf das Quellbild. Diese Menüs zeigen oft SDR-Bilder im Hintergrund, die nicht darstellen, wie das Spiel tatsächlich auf die einzelnen Einstellungen reagieren würde. Letztendlich führt dies nur zu zusätzlicher Verwirrung unter den Spielern, schreckt sie von dieser neuen Technologie ab und erhöht gleichzeitig die Wahrscheinlichkeit, dass sie die Einstellungen durcheinanderbringen und das Spiel auf eine Weise spielen, die nicht den Absichten der Entwickler entspricht.

Wir haben alle möglichen fragwürdigen Verhaltensweisen in Kalibrierungsmenüs gesehen, aber das Lustigste ist definitiv ein (nicht genanntes) Spiel, das standardmäßig 900 Nits als Papierweiß verwendet! Das ist blendend und etwa 4,5-mal heller als die empfohlene Standardhelligkeit.

In Fällen, in denen der Benutzer ein Display mit im Wesentlichen „fake” HDR hat, sollten wir einfach darauf verzichten und stattdessen SDR verwenden.

Du hast vorhin in unserem Gespräch Dolby Vision und HDR10+ erwähnt. Sind diese Technologien für Spiele sinnvoll? Könnten sie für HDR-Gaming überhaupt hilfreich sein?

Ich würde mir wünschen, dass diese Technologien eine größere Rolle in Spielen spielen würden; derzeit wirken sie jedoch eher wie Marketing-Features als wie wirklich transformative Werkzeuge.

Dennoch glaube ich nicht, dass die Arbeit, die dahintersteckt, verschwendet ist. Sowohl Dolby als auch Samsung haben offensichtlich viel Aufwand betrieben, um die Situation zu verbessern, und es gibt echte Vorteile. Trotz dieser Optimierungsbemühungen glaube ich jedoch, dass beide Unternehmen letztendlich etwas geschaffen haben, dessen Implementierung für Entwickler komplizierter ist, das nur bescheidene Erträge bringt und nur begrenzt kompatibel ist.

Da sich die Branche gerade erst an HDR10 gewöhnt, ist es nur natürlich, dass es noch einige Jahre dauern wird, bis wir eine breitere Akzeptanz fortschrittlicherer Formate sehen werden. Die kommenden Formate HDR10+ Advanced und Dolby Vision 2 könnten weitere Fortschritte bringen, daher bin ich wirklich gespannt, wie sich die Dinge entwickeln werden.

Kürzlich hast du auch Entwickler für Fehler bei der Farbkorrektur kritisiert. Wie kann so etwas heutzutage passieren? Gibt es denn keine Tools, die bei solchen Prozessen helfen?

Kurz gesagt, es ist schade, dass die künstlerische Absicht des Spiels bei HDR so oft beeinträchtigt wird. Hinter jedem Studio stehen viele Künstler, die hart daran arbeiten, ein Bild mit einer bestimmten Stimmung zu schaffen. Diese Künstler arbeiten in den allermeisten Fällen mit SDR und führen darin die Farbkorrektur und Beleuchtung durch. Die HDR-Implementierungen in Spielen sind nach wie vor fast immer eine nachträgliche Idee der Technik-/Engine-Teams und nicht von Künstlern vorangetrieben, sodass sie von der künstlerischen Absicht abweichen, die in SDR streng kontrolliert wurde.

In diesen Fällen sind die Künstler selbst damit nicht zufrieden, und das hat in der Regel zwei Folgen:

Sie verhindern, dass das Spiel mit HDR ausgeliefert wird (das passiert häufig bei Unreal Engine-Spielen, wenn sie das gewünschte Aussehen nicht erzielen können).

Sie schlucken ihren Stolz zugunsten des Marketings und akzeptieren, dass HDR anders aussieht als sie es sich vorgestellt haben.

Unreal Engine hat die technischen Anforderungen für die Entwicklung von Spielen massiv gesenkt. Ganze UE-AAA-Spiele werden mit wenigen Engine-Programmierern und oft ohne Grafikprogrammierer entwickelt. Diese Fehler bei der „Farbkorrektur” sind also darauf zurückzuführen, dass die Entwickler entweder nicht wissen, wie man das technisch macht, oder sich einfach nicht darum kümmern.

Wie bereits erwähnt, ist es ein Albtraum, Informationen zu diesem Thema zu finden (versuchen Sie es gar nicht erst mit KI!). Fast alle verfügbaren Tools für Kunst/Grafik/Bilder sind auf SDR festgelegt, und ganze Arbeitsabläufe drehen sich um sie herum. Außerhalb von HDR Den gibt es keine öffentlichen/standardisierten Methoden, um SDR-Pipelines auf HDR umzustellen, sodass Entwickler versuchen, lokale Anpassungsmethoden zu entwickeln. Wie oben erwähnt, ist die Farbkorrektur jedoch eine äußerst heikle Angelegenheit, und eine kleine Änderung in einer mathematischen Formel kann das Aussehen eines Spiels entscheidend beeinflussen, sodass die Ergebnisse oft zu wünschen übrig lassen.

Gibt es etwas, was Entwickler in Bezug auf die Grafikwiedergabe tun könnten, um HDR-Gaming noch besser zur Geltung zu bringen, als dies bereits der Fall ist? Zum Beispiel mit Beleuchtung?

Ja! Die meisten Spiel-Engines leisten gute Arbeit in Bezug auf PBR und den dynamischen Helligkeitsbereich in der Szene. Mit einer Ausnahme (Gran Turismo?) sind jedoch alle Spiele auf den Farbraum Rec. 709/sRGB beschränkt und erzeugen nur gelegentlich während der Nachbearbeitung Farben, die darüber hinausgehen. Wir müssen so schnell wie möglich zu breiteren Farbräumen wie Rec. 2020 für Albedo-Texturen (Farben) und Lichtfarben übergehen. Nur dann werden wir atemberaubendes HDR in Spielen haben. Fernseher werden von Jahr zu Jahr besser und wir nähern uns 2500 Nits mit einer Abdeckung von 90 % von Rec. 2020.

Vielen Dank für deine Zeit. Im Interesse des HDR-Gamings hoffen wir, dass endlich genügend deiner Kollegen in der Spieleentwicklung darauf aufmerksam werden.

https://wccftech.com/the-hdr-gaming-interview-veteran-developer-explains-its-sad-state-and-how-hes-coming-to-its-rescue/ (Grafiken mit zusätzlichen Erläuterungen im Link)

ghostdog83Teilnehmer

ghostdog83TeilnehmerDiese Analogie von Dan Houser ist durchaus erwähnenswert, was die Problematik betrifft, wenn die AI auf Basis ihrer eigenen Daten oder der anderer AIs trainiert wird, was zu einer Art informativen Inzest führt (woraus nach einer Studie abgeleitet wird, dass dies zu einem Kollaps der Modelle führen kann):

Es ist in etwa so, als hätten wir Kühe mit Kühen gefüttert und dadurch die Rinderwahnsinnskrankheit bekommen.

„AI wird sich letztendlich selbst auffressen.“

Dan Houser, Mitbegründer von Rockstar und ehemaliger Autor von Grand Theft Auto, hat AI mit der Rinderwahnsinnskrankheit verglichen und gesagt, dass die Menschheit „von einer bestimmten Gruppe von Leuten, die vielleicht nicht ganz normale Menschen sind“, in eine bestimmte Richtung gedrängt wird.

Die Auswirkungen der künstlichen Intelligenz waren schnell und einschneidend, wobei das Aufkommen von Technologien wie ChatGPT eine Wirtschaftsblase angeheizt hat, von der einige befürchten, dass sie platzen könnte. Auch die Funktionsweise des Internets wird neu gestaltet, wobei die Idee der fairen Nutzung von Inhalten für das Training von KI-Modellen im Widerspruch zum Urheberrechtsschutz steht. Dies hat zu laufenden Rechtsstreitigkeiten geführt. Disney und Universal haben beispielsweise den AI-Bildgenerator Midjourney verklagt und behaupten, das Unternehmen habe AI-generierte Figuren aus ihren Filmen unrechtmäßig verwendet und verbreitet. Disney hat außerdem eine Unterlassungserklärung an Character.AI geschickt und das Start-up aufgefordert, die unbefugte Verwendung seiner urheberrechtlich geschützten Figuren einzustellen.

Hier kommt Dan Houser ins Spiel, der Rockstar 2020 verlassen hat, um Absurd Ventures zu gründen, nachdem er bis dahin an so ziemlich allen Spielen des Studios mitgearbeitet hatte. Sein neuer Roman „A Better Paradise“ dreht sich um AI, und so ist es nur logisch, dass er in einem kürzlichen Interview mit Virgin Radio UK zu dieser Technologie befragt wurde.

Man kann mit Fug und Recht sagen, dass Houser der Zukunft der künstlichen Intelligenz skeptisch gegenübersteht.

„Einige dieser Leute, die versuchen, die Zukunft der Menschheit, der Kreativität oder was auch immer mit Hilfe von AI zu definieren, sind nicht gerade die humansten oder kreativsten Menschen“, sagte er. „Sie sagen also gewissermaßen, dass wir besser darin sind, menschlich zu sein als ihr. Und das ist offensichtlich nicht wahr.

„Das ist eine der anderen Dinge, die wir zu erfassen versuchen: dass die Menschheit von einer bestimmten Gruppe von Menschen, die vielleicht keine voll entwickelten Menschen sind, in eine bestimmte Richtung gezogen wird.“

Er fuhr fort: „Ich glaube, dass die künstliche Intelligenz sich letztendlich selbst auffressen wird. Soweit ich das verstehe, und das ist wirklich nur ein oberflächliches Verständnis, durchsuchen die Modelle das Internet nach Informationen, aber das Internet wird immer mehr mit Informationen gefüllt sein, die von den Modellen selbst erstellt wurden. Das ist in etwa so, als hätten wir Kühe mit Kühen gefüttert und dann die Rinderwahnsinnskrankheit bekommen.

Ich kann nicht erkennen, wie die Informationen besser werden sollen. Ihnen gehen bereits die Daten aus. Sie werden einige Aufgaben brillant erledigen können, aber nicht alle Aufgaben. Sie werden zu einer Art Spiegel ihrer selbst werden.

Ich bin etwas besessen von der Tatsache, dass man bei einer erneuten Suche nach derselben Sache nicht dieselben Antworten erhält. Und oft sind diese Antworten falsch, aber sie werden mit großer Überzeugung gegeben.“

Houser spricht hier darüber, was passiert, wenn AI-Modelle beginnen, auf ihre eigenen Ergebnisse zu trainieren, was laut Experten das Risiko eines Zusammenbruchs mit sich bringt. Die Large Language Models (LLMs), die ChatGPT und ähnliche Programme antreiben, sollen sich durch Garbage In/Garbage Out (GIGO) selbst kannibalisieren. Oder, wie Houser es ausdrückt: „Es ist in etwa so, als hätten wir Kühe mit Kühen gefüttert und dadurch die Rinderwahnsinnskrankheit bekommen.“

Der Einsatz von AI in der Unterhaltungsbranche ist eines der heißesten Themen in den Bereichen Videospiele, Filme und Fernsehen. Im vergangenen Monat behauptete der CEO von Genvid – dem Unternehmen hinter interaktiven Serien wie Silent Hill Ascension, bei denen man sein eigenes Abenteuer wählen kann –, dass „die Verbraucher sich im Allgemeinen nicht für generative AI in Spielen interessieren“ und erklärte: „Die Generation Z liebt AI-Schund.“

Es gibt jedoch Widerstand. Diese Woche sah sich Epic Games wegen dem, was Fans für AI-generierte Kunst in Fortnite halten, heftig Kritik ausgesetzt.

ghostdog83Teilnehmer

ghostdog83TeilnehmerEin solcher Wertungsdurchschnitt sollte im Grunde niemanden davor abhalten, es spielen zu wollen.

Es scheint ein gutes Spiel zu sein mit vereinzelten Designentscheidungen, die je nach persönlicher Gewichtung mehr oder weniger stark mit eingepreist werden müssen. Sicherlicht nichts, was für den Spielspaß in seiner Gesamtheit sonderlich abträglich wäre.

ghostdog83Teilnehmer

ghostdog83TeilnehmerDie Wertung ist an und für sich gut, aber im Vergleich zu den anderen Teilen ist das auf Metacritic schon ein deutlicher Wertungsunterschied nach unten (Prime (97), Echoes (92), Corruption (90)).

ghostdog83Teilnehmer

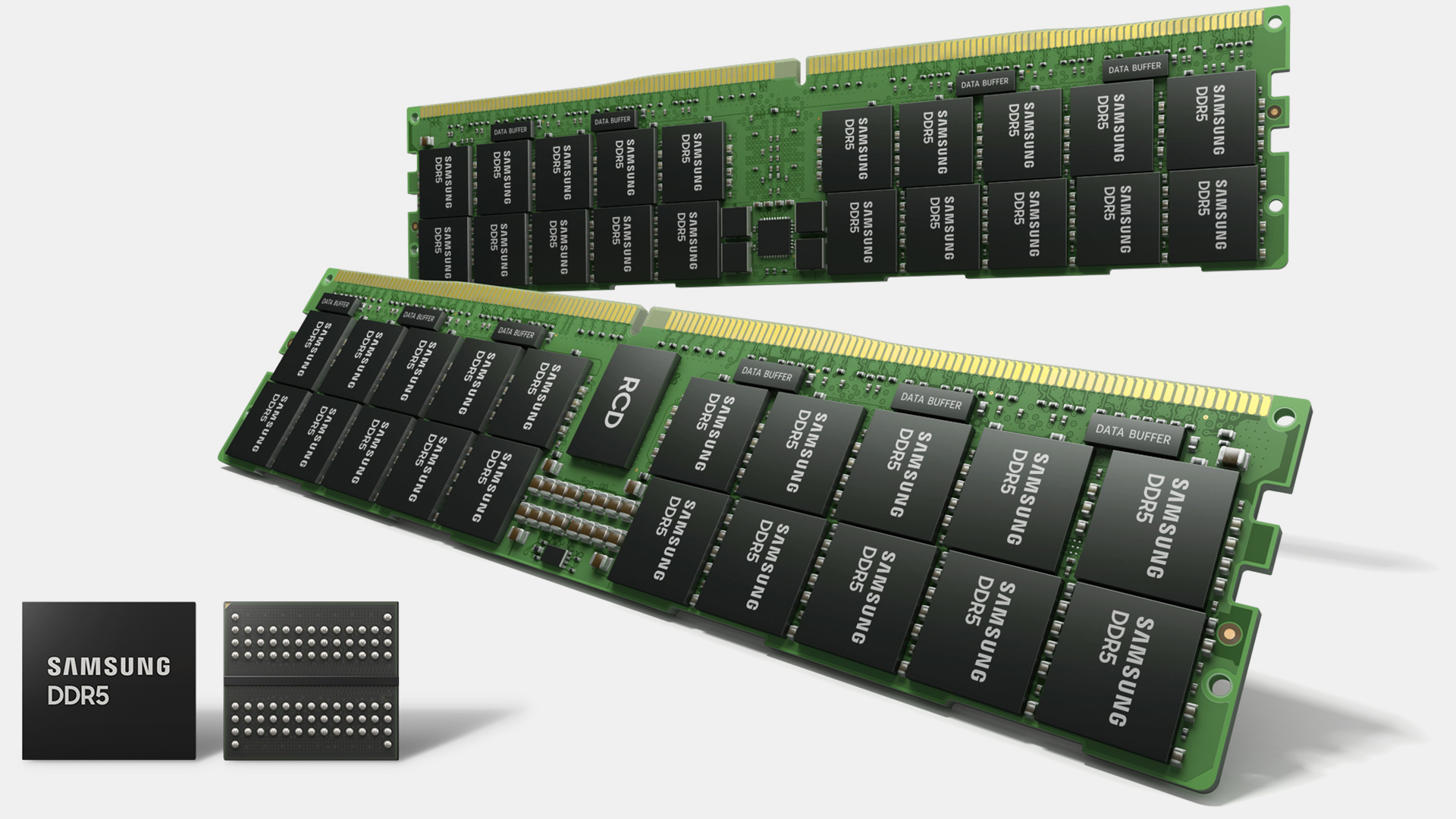

ghostdog83TeilnehmerDie RAM-Preiskrise hat gerade erst begonnen, warnt der Geschäftsführer von Team Group – er sagt, dass sich das Problem 2026 verschärfen wird, da sich die DRAM- und NAND-Preise innerhalb eines Monats verdoppeln werden.

Der anhaltende Strukturwandel auf dem DRAM-Markt, der durch die Verlagerung der Produktionskapazitäten auf die Herstellung von Hochbandbreitenspeichern (HBM) für KI-Beschleuniger verursacht wird, hat bereits zu einem massiven Preisanstieg bei DDR- und LPDDR-Speichern geführt. Das Schlimmste steht jedoch noch bevor. Laut dem Geschäftsführer von TeamGroup haben sich die Vertragspreise für DRAM- und NAND-Produkte in letzter Zeit fast verdoppelt. Die Versorgung mit Standard-Speichern wird sich Anfang 2026 weiter verschlechtern, und eine Normalisierung ist laut DigiTimes vor 2027–2028, wenn mehr Produktionskapazitäten zur Verfügung stehen, unwahrscheinlich.

Laut Gerry Chen, Geschäftsführer von TeamGroup, einem führenden Hersteller von Speichermodulen, Solid-State-Laufwerken und Produkten auf Basis von 3D-NAND, stiegen die Vertragspreise für einige Kategorien von DRAM und 3D-NAND im Dezember gegenüber dem Vormonat um 80 % bis 100 %. Die Spotpreise zeigen ein ähnliches Bild. Ein 16-Gb-DDR5-Chip kostete am 20. September bei DRAMeXchange durchschnittlich 6,84 US-Dollar. Am 19. November lag der durchschnittliche Spotpreis bei 24,83 US-Dollar, aber am 1. Dezember stieg der durchschnittliche Spotpreis für einen 16-Gb-DDR5-IC auf 27,2 US-Dollar (Tiefstkurs der Sitzung lag bei 19 US-Dollar, Höchstkurs bei 37 US-Dollar). Im Wesentlichen kostet allein der Speicher für ein 16-GB-Speichermodul etwa 217,6 US-Dollar. Eine Leiterplatte, die Montage und das Testen sowie zusätzliche Teile wie PMIC kommen noch einmal mit 8 bis 10 US-Dollar hinzu, sodass ein 16-GB-Speichermodul nun 225 bis 228 US-Dollar kostet, ohne Herstelleraufschlag, Logistik und Steuern.

Chen geht davon aus, dass sich die Verfügbarkeit von DRAM und NAND im ersten und zweiten Quartal 2026 verschlechtern wird, sobald die Vertriebslagerbestände aufgebraucht sind. Er warnt davor, dass es zu diesem Zeitpunkt unabhängig von der Zahlungsbereitschaft schwierig werden könnte, eine Zuteilung zu erhalten. Seiner Ansicht nach wird es keine schnelle Entspannung geben: Er geht davon aus, dass sich die derzeitige Knappheit bis Ende 2027 und möglicherweise darüber hinaus fortsetzen wird.

Der Grund für die Verknappung von Standard-Speichern ist bekannt: DRAM-Hersteller verlagern ihre Produktionskapazitäten auf HBM (das größere DRAM-Chips als Standard-Speicher verwendet), das von KI-Beschleunigern wie dem B300 von Nvidia oder kundenspezifischen Beschleunigern großer Cloud-Dienstleister wie AWS, Google und Microsoft verwendet wird. Diese Unternehmen neigen dazu, ihre Lieferungen Jahre im Voraus zu buchen, sodass die DRAM-Hersteller irgendwann nicht mehr über ausreichende Kapazitäten verfügen werden, um die Nachfrage nach Standard-DRAMs zu befriedigen.

Der Bau einer neuen Greenfield-Fabrik dauert mindestens drei Jahre. Selbst wenn Unternehmen wie Micron, Samsung oder SK hynix heute den Bau einer Speicherfabrik beschließen würden, könnte diese frühestens Ende 2028 in Betrieb genommen werden und wäre erst irgendwann im Jahr 2029 voll ausgelastet.

Was NAND betrifft, so geben NAND-Anbieter ebenfalls großen Kunden Vorrang, bei denen es sich zufällig um Hersteller von KI-Servern handelt. Chen geht nicht davon aus, dass sich die Kapazitäten im Jahr 2026 wieder auf PCs, Smartphones und andere Verbrauchergeräte verlagern werden, was sich auf die Preise dieser Geräte auswirken wird.

Die Auswirkungen sind deutlich zu sehen. Enthusiasten beobachten, dass die RAM-Preise für maßgeschneiderte PCs von Woche zu Woche um ein Vielfaches steigen, wobei 64 GB DDR5-RAM in einigen Fällen mittlerweile mehr kosten als eine PS5. Die RAM-Angebote zum Black Friday und Cyber Monday in dieser Woche könnten die letzte Chance sein, RAM zu kaufen, bevor die Preise noch weiter in die Höhe schnellen.

Dem Bericht nach wird die Krise bis mindesten Ende 2027 anhalten.

Die Vertriebslagerbestände an DRAM und NAND könnten bereits in der ersten Jahreshälfte 2026 leer werden.

Neue Speicherfabriken frühestens gegen Ende 2028 mit Vollauslastung im Verlauf des Jahres 2029.

ghostdog83Teilnehmer

ghostdog83TeilnehmerIn der Woche vom 17. bis 23. November hat sich die Xbox One in Spanien mehr als doppelt so häufig verkauft als die Xbox Series:

Xbox One: 1700 Einheiten

Xbox Series: 700 Einheiten ghostdog83Teilnehmer

ghostdog83TeilnehmerCyberPowerPC gibt bekannt, dass die Preise für RAM um 500 % und für SSD um 100 % gestiegen sind, was das Unternehmen dazu zwingt, die Preise für vorgefertigte Systeme zu erhöhen.

Seit Oktober sind die DRAM-Preise wahnsinnig hoch gestiegen und haben diesen Monat einen steilen Anstieg verzeichnet. Dies hat bereits zu einer Verdopplung bis Vervierfachung der Preise für DDR5-RAM-Module/-Kits in den meisten Regionen geführt. CyberPowerPC gibt jedoch an, dass die RAM-Preise um 500 % gestiegen sind, was im Wesentlichen einer Versechsfachung entspricht. DDR5-RAM-Kits zum sechsfachen des ursprünglichen Preises sind glücklicherweise nicht üblich. Allerdings haben wir einige 64-GB-RAM-Kits gesehen, die mit über 800 US-Dollar fast das Vierfache des üblichen Preises kosten.

Auch die NAND-Preise sind deutlich gestiegen, was zu höheren SSD-Kosten geführt hat, die bereits mehrere Systemintegratoren und Mini-PC-Hersteller dazu gezwungen haben, die Preise für ihre Geräte zu erhöhen. CyberPowerPC, ein beliebter Systemintegrator, hat gerade dasselbe angekündigt. Das Unternehmen gibt an, dass es aufgrund der höheren Kosten die Preise für alle Systeme ab dem 7. Dezember 2025 anpassen muss.

Wir sind also nur noch knapp 12 Tage von höheren Preisen für vorgefertigte Systeme von CyberPowerPC entfernt, was bedeutet, dass die Nutzer noch etwas Zeit haben, bevor selbst bei preisgünstigen PC-Konfigurationen weitere 100 bis 200 Dollar hinzukommen. Die Preiserhöhung kann sogar noch höher ausfallen, wenn Sie sich für eine RAM-Kapazität von 64 GB entscheiden, und die höheren Kosten für SSDs werden den Preis weiter in die Höhe treiben.

ghostdog83Teilnehmer

ghostdog83TeilnehmerEin Thema, was nicht gänzlich unbekannt ist, aber dennoch erwähnenswert bleibt, da nicht jeder damit vertraut ist, was die Archivierung von Daten (in dem Fall Spiele) mittels SSDs betrifft:

Die nicht mit Strom versorgten SSDs in Ihrer Schublade verlieren langsam Ihre Daten

“SSDs haben Festplatten als primären Speicher fast vollständig ersetzt. Sie sind um ein Vielfaches schneller, praktischer und verbrauchen weniger Strom als mechanische Festplatten. Wenn Sie SSDs jedoch auch für die Langzeitspeicherung verwenden und erwarten, dass die Laufwerke in Ihrer Schublade auch nach Jahren noch einwandfrei funktionieren, sollten Sie Ihre Strategie vielleicht überdenken. Ihre zuverlässige SSD könnte Datenverluste oder -beschädigungen erleiden, wenn sie über einen längeren Zeitraum nicht mit Strom versorgt wird. Aus diesem Grund betrachten viele Benutzer SSDs nicht als zuverlässiges Langzeitspeichermedium und bevorzugen stattdessen Festplatten, Magnetbänder oder M-Discs.”

Das oben beschriebene Szenario ist für Personen außerhalb von Unternehmen, Enthusiasten und Solopreneuren nicht relevant. Die Notwendigkeit, große Datenmengen über Jahre hinweg auf Laufwerken zu speichern, die nicht angeschlossen sind, ist für die meisten Menschen kein Thema, da sie ein oder zwei SSDs in ihrem PC verwenden, die höchstens einige Monate lang ohne Stromversorgung bleiben. Wahrscheinlich haben Sie Daten auf Ihrer SSD eher aufgrund einer seltenen Überspannung oder eines defekten Laufwerks als aufgrund eines Spannungsverlusts verloren. Einige Faktoren, wie die Temperatur und die Qualität des zugrunde liegenden NAND-Flash-Speichers, können diesen Spannungsverlust beschleunigen.

SSDs sind nicht unbegrenzt haltbar, selbst wenn Sie sie ständig eingeschaltet lassen. Die begrenzten Schreibzyklen des NAND-Flash-Speichers führen letztendlich zum Ende der Lebensdauer einer SSD, aber die meisten Nutzer werden das Laufwerk wahrscheinlich ersetzen, bevor dies jemals geschieht. Sie müssen sich also keine Sorgen machen, wenn Sie zu viele Daten auf Ihre SSD schreiben oder Ihren PC tagelang, wochenlang oder sogar monatelang ausgeschaltet lassen. Vertrauen Sie nur keiner SSD ohne Stromversorgung, die seit Jahren zu Hause verstaubt, was mich zu meinem nächsten Punkt bringt.

Im Gegensatz zu Festplatten, die rotierende Scheiben magnetisieren, um Daten zu speichern, ändern SSDs die elektrische Ladung in NAND-Flash-Zellen, um 0 und 1 darzustellen. NAND-Flash speichert Daten in den zugrunde liegenden Transistoren auch dann, wenn die Stromversorgung unterbrochen wird, ähnlich wie andere Formen nichtflüchtiger Speicher. Entscheidend ist jedoch, wie lange Ihre SSD Daten ohne Stromversorgung speichern kann. Selbst die günstigsten SSDs, beispielsweise solche mit QLC-NAND, können Daten nach vollständiger Stromunterbrechung etwa ein Jahr lang sicher speichern. Teurere TLC-NAND-Speicher können Daten bis zu 3 Jahre lang speichern, während MLC- und SLC-NAND-Speicher für 5 bzw. 10 Jahre ohne Stromversorgung geeignet sind.

Das Problem ist, dass die meisten SSDs für Verbraucher nur TLC- oder QLC-NAND verwenden, sodass Benutzer, die ihre SSDs länger als ein Jahr ohne Stromversorgung lassen, die Integrität ihrer Daten gefährden. Die Zuverlässigkeit von QLC-NAND hat sich im Laufe der Jahre verbessert, sodass Sie wahrscheinlich 2–3 Jahre ohne Stromversorgung als Richtwert betrachten sollten. Ohne Stromversorgung kann die in den NAND-Zellen gespeicherte Spannung verloren gehen, was entweder zu Datenverlusten oder zu völlig unbrauchbaren Laufwerken führen kann.

Diese mangelnde Datenspeicherfähigkeit von SSDs für Verbraucher macht sie zu einem unzuverlässigen Medium für die langfristige Datenspeicherung, insbesondere für Kreativprofis und Forscher. Auch HDDs können aufgrund von Verschleiß unter Bitrot leiden, sind aber dennoch widerstandsfähiger gegen Stromausfälle. Wenn Sie Ihre Archive schon länger nicht mehr überprüft haben, würde ich Ihnen empfehlen, dies so bald wie möglich zu tun.

Das Sichern Ihrer Daten ist die einfachste Strategie, um den Einschränkungen von Speichermedien entgegenzuwirken. Wenn Sie mehrere Kopien Ihrer Daten auf verschiedenen Speichermedien haben, ist sichergestellt, dass Ihre Daten bei unerwarteten Zwischenfällen nicht für immer verloren gehen. Genau darum geht es bei der 3-2-1-Backup-Regel: 3 Kopien der Daten auf mindestens 2 verschiedenen Speichermedien, wobei 1 Kopie außerhalb des Standorts gespeichert wird. Für die meisten Menschen lässt sich diese Bedingung leicht erfüllen, indem sie ihren Hauptcomputer, ein NAS und Cloud-Speicher verwenden. Redundanz ist das Grundprinzip, das Ihre Daten schützt.

Ob es nun um die begrenzte Lebensdauer Ihrer SSD, das Potenzial für schädliche Notfälle wie Stromausfälle oder die Grenzen der Datenaufbewahrung auf Flash-Speichern geht – Ihr Backup sorgt für Ihre Sicherheit. Ja, SSDs sind nicht die beste Wahl für die Langzeitspeicherung, aber selbst wenn Sie Festplatten verwenden, ist es riskant, nur eine einzige Kopie Ihrer Daten zu haben. Jeder Benutzer wird früher oder später mit einem Festplattenausfall konfrontiert, daher ist die Investition in ein robustes Backup-System keine Option, wenn Ihnen Ihre Daten wichtig sind.

Solange Sie Consumer-SSDs als primären Speicher auf Ihrem PC verwenden, ist alles in Ordnung. Wahrscheinlich werden Sie Ihr Laufwerk ersetzen, lange bevor dessen P/E-Zyklen erschöpft sind. Für die Langzeitspeicherung ist es jedoch riskant, sich auf SSDs zu verlassen, da diese Daten verlieren können, wenn sie über Jahre hinweg ohne Stromversorgung bleiben. Dieser Datenverlust kann jederzeit zwischen 1 und 3 Jahren nach dem Ausschalten Ihrer SSDs auftreten. Daher sollten Sie vorrangig alternative Speichermedien verwenden und in ein Backup-System investieren.

https://www.xda-developers.com/your-unpowered-ssd-is-slowly-losing-your-data/

26. November 2025 um 16:09 als Antwort auf: Die Zukunft von Tomb Raider- wie soll der neue Teil aussehen? #1810756 ghostdog83Teilnehmer

ghostdog83TeilnehmerAuf keinen Fall Open World. Hub Bereiche, kleinere Gebiete zum Erkunden ja.

Je größer das wird, desto größer wäre die Gefahr von der Ubisoft Seuche geplagt zu werden. Denn dann stellt sich nämlich die Frage, was man mit der großen offenen Spielwelt alles anfangen soll, um den Spieler beschäftigt zu halten. Die Antwort spiegelt dann auch die Möglichkeiten an Zeit und Geld wieder, die tendenziell in eine Richtung gehen, die wir leidig aus anderen Spielen kennen.

In der Theorie kann Open World etwas Großartiges sein. In der Praxis stößt es aber zu häufig an seine Grenzen, was die Möglichkeiten anbelangt, weil die dafür nötigen Mittel nicht vorhanden sind. Am Ende bleibt es ein Wunschdenken.

ghostdog83Teilnehmer

ghostdog83Teilnehmerich hatte nie probleme mit abwechslungsarmer umgebung wenn das was ich sehe genau mein ding ist. liebe zb die relativ abwechslungsarme umgebung in dead space oder alien isolation..

Etwas in einem insolierten Szenario zu verankern, bedeuten nicht, dass damit die Möglichkeiten, abwechslungsreiche Umgebungen zu erschaffen, verbaut werden.

Vielmehr ist es eine Frage von Zeit und Geld.

Liegt beides im üppigen Maße vor, kannst du innerhalb eines Szenarios sehr viel Abwechslung erzeugen, indem du die Individualität hochfährst durch einen hohen Detailgrad und mannigfaltige Assets, wodurch du einzigartige, voneinander unterscheidbare Umgebungen und Räumlichkeiten erzeugen kannst.

Alien Isolation ist für mich ein Musterbeispiel, wie abwechslungsreich ein Spiel innerhalb eines Szenarios aussehen kann, wenn man die dafür nötigen Ressourcen zur Verfügung hat. Vergleicht man nämlich die einzelnen Bereiche der Station, ergeben sich teils sehr starke visuelle Unterschiede.

Ich habe aus dem Grund auch keinen Vergleich zu einem Titel wie Alien Isolation gezogen (hinsichtlich der eigenen Erwartungen). Das wäre gegenüber Total Chaos schlicht nicht fair. Sam Prebble wird das Beste aus der Situation herausgeholt haben, was die Möglichkeiten betrifft.

Grundsätzlich ist das auch kein Beinbruch, wenn ein, zwei Aspekte nicht ganz der eigenen Vorstellung entsprechen, wenn der Rest dafür stimmt.

Ein gutes Beispiel dafür wäre Marvel’s Guardians of the Galaxy. Das Spiel wird im Grunde für alles gelobt außer dem Gameplay (monoton, zweckmäßig). Im Gesamtpaket hat der Titel dennoch sehr viel Anklang bei den Spielern finden können, wenn es nach dem generellen Tenor geht.

edit: Zuletzt hatte ich Call of The Sea angespielt (was ich wohl als nächsten Titel in meinem backlog angehen werde), was voll von kleinen liebevollen Details in der Umgebung nur so strotzt, auf einer isolierten Insel spielt. Hat einen positiven Ersteindruck hinterlassen und mich an klassiche 3D PC-Adventure zurückerinnert.

ghostdog83Teilnehmer

ghostdog83TeilnehmerAus dem Grund war ich auch sehr positiv überrascht, wie gut sie in Trepang2 ist. Wie gesagt, wir reden hier von einem Team aus 4 Personen, wovon einer für die KI zuständig war.

Davor hatte ich RoboCop: Rogue City durchgespielt, wo die Schießereien mit der Zeit ziemlich monoton wurden und sich fast schon wie Arbeit angefühlt haben. Wobei man hier zugutehalten kann, dass die Bösewichte in der Vorlage auch nur Schießbuden sind.

Rein auf das Gameplay reduziert ist RoboCop für mich kein wirklich gutes Spiel (eher zweckmäßig). Die Bosskämpfe gegen ED-209 empfinde ich sogar als Totalausfall.

-

AutorBeiträge